Il più grande errore che si può fare valutando l'impatto delle tecnologie emergenti

Nei dibattiti sulle tecnologie emergenti, chiacchiere da bar a parte, noto spesso che molte argomentazioni sono fondamentalmente difettose.

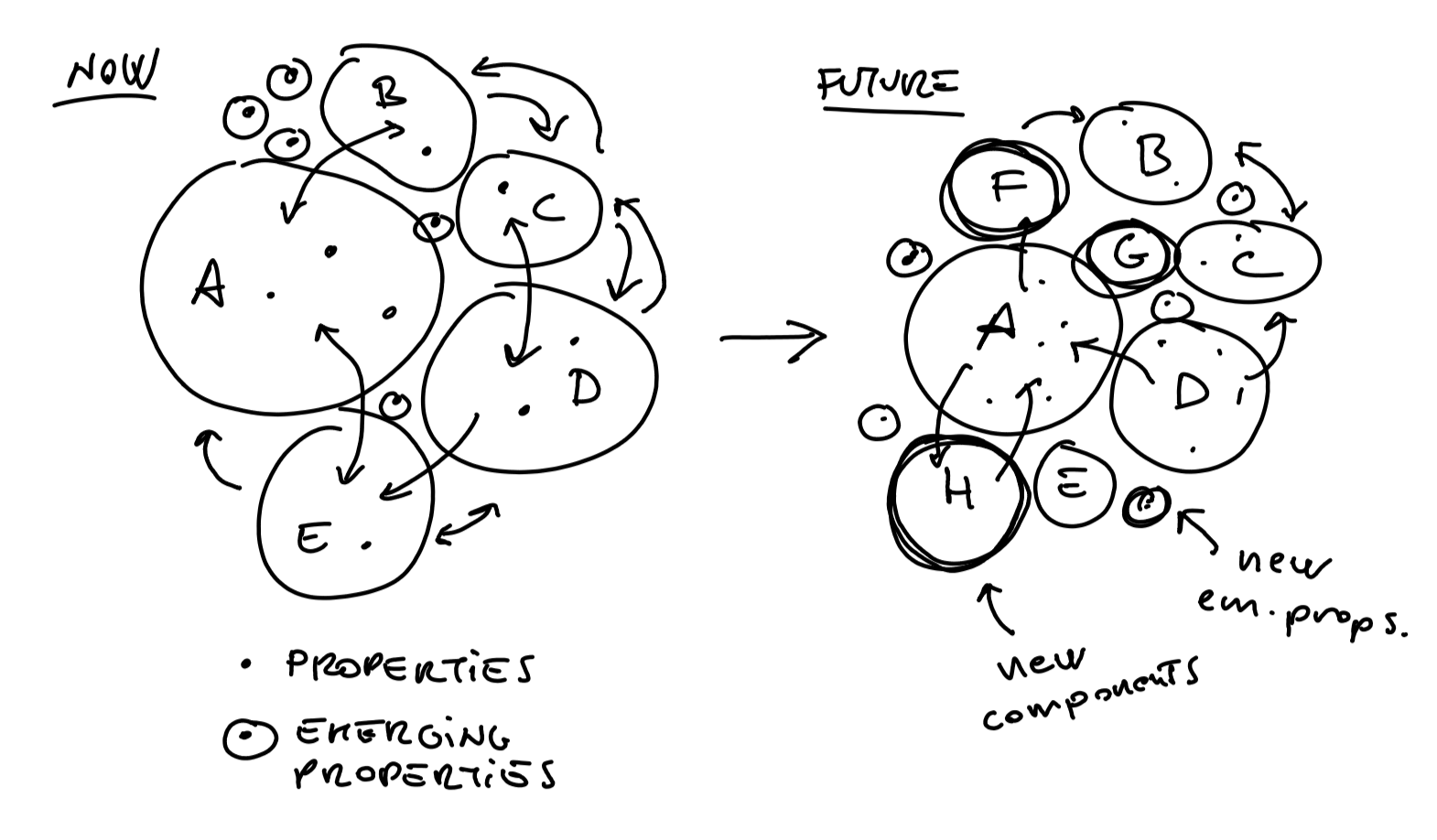

Quando ci si domanda come sarà il futuro e si cercano risposte nelle sole proiezioni di trend e schemi conosciuti si sta omettendo una parte fondante dei sistemi complessi: le proprietà emergenti, quelle non osservabili prima che il sistema raggiunga un determinato stato, date dall’interazione fra i suoi componenti.

Quando pensiamo a uno scenario futuro è fondamentale provare a immaginare quali saranno le proprietà emergenti di quel sistema, avendo cura di avere prima individuato anche i nuovi componenti del sistema non presenti attualmente (come ad esempio il fatto che dopo l’introduzione di una variabile, i sistemi cambiano e le componenti di partenza evolveranno).

Come facciamo a dire come sarà il mondo dopo l’IA generativa senza immaginare come ci adatteremo e reagiremo nel percorso? (ad esempio specializzandoci e cambiando preferenze, creando cose nuove, ecc?)

Quando nel 2015, per la prima volta nella storia, il software AlphaGo sconfisse un giocatore professionista tutti pensarono che la macchina aveva ucciso il gioco per sempre. Quello che accadde negli anni successivi fu invece un aumento di invenzioni di nuove mosse ad opera di giocatori umani, cosa che non accadeva da decenni, e come dicono gli autori dello studio: “scopriamo che l’IA può aver migliorato il processo decisionale umano e che questo miglioramento è stato associato a una maggiore novità nel processo decisionale, in quanto i giocatori umani sono stati incoraggiati a prendere decisioni precedentemente non osservate nella storia” (Shin et al. 2023)

Quindi per pensare alla nostra società a valle dell’introduzione di una tecnologia emergente dobbiamo usare gli effetti delle prime reazioni del sistema – socio-tecnico – come nuove caratteristiche dello scenario su cui ragionare. Il ragionamento sugli effetti di primo livello ci deve orientare nelle decisioni riguardanti la sicurezza ed i fattori di rischio imminenti, ma quello sugli effetti combinati è più importante perché mirato agli effetti di medio-lungo periodo (quindi potenzialmente anche alla mappatura di rischi maggiori), e perché ci aiuta a cogliere i segnali deboli (quelli per l’innovazione e la pianificazione).

Questo è quello che mi colpisce fai più, ma quali e quanti altri errori significativi si fanno nel valutare l’impatto delle tecnologie?

\

Riferimenti

Shin, M., Kim, J., Van Opheusden, B., & Griffiths, T. L. (2023). Superhuman artificial intelligence can improve human decision-making by increasing novelty. Proceedings of the National Academy of Sciences, 120(12), e2214840120. https://doi.org/10.1073/pnas.2214840120